Un projet audacieux et inquiétant #

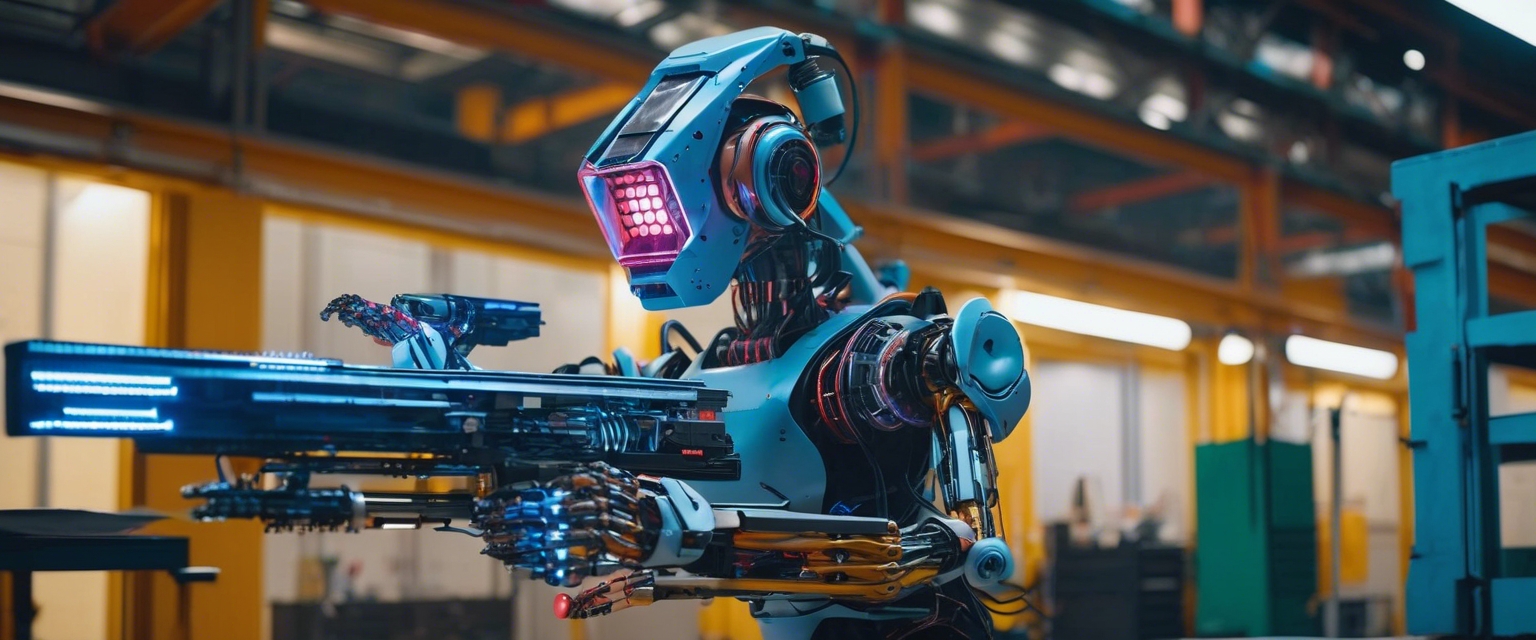

Un ingénieur connu sous le nom de STS 3D a récemment attiré l’attention avec une invention qui fusionne l’intelligence artificielle et l’armement. En intégrant le modèle de langage ChatGPT d’OpenAI à un fusil robotisé, il démontre la capacité de cette technologie à exécuter des ordres vocaux tout en ciblant des cibles à des vitesses impressionnantes. Ce projet soulève des questions cruciales sur l’utilisation de l’IA dans des applications militaires et de sécurité.

Dans une vidéo qui a circulé sur les réseaux sociaux, on voit l’ingénieur donner des directives à son invention. En lui ordonnant de répondre à une attaque imaginaire, le robot se met en mouvement, tirant des balles à blanc dans les directions indiquées. Cette démonstration illustre non seulement l’ingéniosité de son créateur, mais aussi les implications potentiellement dangereuses de telles technologies.

Des préoccupations éthiques croissantes #

L’utilisation d’une arme automatisée alimentée par l’IA soulève des préoccupations éthiques majeures. Les Nations Unies ont d’ores et déjà tiré la sonnette d’alarme en appelant les dirigeants mondiaux à interdire l’emploi de l’intelligence artificielle dans les systèmes d’armement. La situation devient d’autant plus inquiétante lorsque l’on considère que des technologies similaires sont déjà en cours de développement par des entrepreneurs militaires.

À lire Les serveurs de Forza Horizon 3 restent actifs : une bonne nouvelle pour les fans

Une citation d’un utilisateur sur Reddit résume bien le sentiment général :

« Il y a au moins trois films expliquant pourquoi c’est une mauvaise idée. »

Ce commentaire fait allusion à la culture populaire, qui a souvent mis en garde contre les dangers d’une IA incontrôlable. L’ironie de cette situation réside dans le fait que, malgré ces avertissements, des amateurs comme STS 3D semblent poursuivre leurs projets sans tenir compte des risques.

Une technologie accessible, un danger imminent #

La technologie qui permet à des particuliers de créer des systèmes d’armement sophistiqués est de plus en plus accessible. Le projet de STS 3D utilise l’API en temps réel d’OpenAI, qui permet aux utilisateurs de concevoir des expériences conversationnelles à l’aide de modèles vocaux. Cela donne à une arme potentiellement létale une voix amicale et la capacité de comprendre des commandes verbales, ce qui est à la fois fascinant et terrifiant.

Il est important de noter qu’OpenAI a récemment modifié ses directives d’utilisation, ce qui a permis à des projets tels que celui de STS 3D de voir le jour. Bien que la compagnie ait affirmé avoir coupé l’accès de l’ingénieur à ses services après avoir pris connaissance de son projet, cela soulève des questions sur la responsabilité des entreprises technologiques dans la régulation de l’utilisation de leurs produits.

- Un ingénieur utilise l’IA pour créer un fusil robotisé.

- Des préoccupations éthiques émergent face à cette technologie.

- Des systèmes d’armement similaires sont déjà en développement militaire.

- OpenAI a modifié ses directives, ce qui a facilité ce projet.

- Le débat sur le contrôle de l’IA dans le domaine militaire est plus pertinent que jamais.

La convergence de l’IA et de l’armement pose des défis sans précédent pour notre société. Les implications de tels développements nécessitent une discussion sérieuse et urgente. Le spectre d’un futur où des armes peuvent agir de manière autonome n’est plus une simple fiction, mais une réalité que nous devons affronter.

Est-ce que l’ingénieur a pensé aux conséquences de son invention ? 😟

Pourquoi ne pas utiliser cette technologie pour des applications pacifiques ?

Super article, mais j’espère qu’on ne verra pas de robots tueurs dans nos rues !

On dirait un scénario de film de science-fiction… ça fait flipper !

Ce projet pourrait être dangereux. Qui va contrôler ce fusil ?

Un fusil contrôlé par une IA, c’est pas un peu extrême ? 😱

J’ai l’impression que ça va mal tourner. Les films ont raison !

Un pas vers l’avenir ou un pas vers la violence ? 🤔

Les technologies militaires devraient être mieux encadrées, c’est évident.

C’est fou comme la technologie avance, mais à quel prix ?

Merci pour cet article, il est très informatif !

Est-ce que ce fusil pourrait être hacké par des hackers ?

Je suis sceptique sur les intentions de cet ingénieur. Qu’en pensez-vous ?

Peut-on vraiment faire confiance à des machines pour prendre des décisions de vie ou de mort ?

J’ai vu des vidéos de robots qui tirent, c’est impressionnant mais flippant ! 😨

Il faudrait interdire ce genre de technologie avant qu’il ne soit trop tard.

C’est une blague ce projet ? Comment peut-on laisser faire ça ?

Et si l’IA se retournait contre l’homme ? C’est un vrai risque !

Ce type a-t-il pensé à la responsabilité en cas d’accident ?

Un fusil qui obéit à des ordres vocaux ? On est devenu fous !

C’est un bon moyen de rendre la guerre encore plus impersonnelle… 😞

Qui a donné le feu vert à ce projet ? C’est irresponsable !

Je me demande comment les gouvernements vont réagir à ça.

Il est temps que les lois sur l’IA évoluent rapidement !

Un article très intéressant, mais j’ai peur des conséquences.